Voice AI im Recruiting ist gerade eines der aktivsten Felder in HR-Tech. AI Voice Agents, die Bewerber am Telefon interviewen und vorselektieren, tauchen in immer mehr Produktankündigungen auf. 82% der HR-Leader planen laut Gartner, bis Mitte 2026 eine Form von agentic AI in ihren HR-Funktionen einzusetzen [1]. Immer mehr Anbieter bringen Voice-AI-Screening-Agents auf den Markt. Was vor wenigen Jahren ein Nischenthema war, ist laut Staffing Industry Analysts inzwischen ein wachsendes Ökosystem mit Anbietern wie ConverzAI, HeyMilo, Bullhorn und Glider AI [2].

Grund genug, sich die Datenlage zur Akzeptanz von Voice AI etwas genauer anzuschauen. Was sagen die aktuellen Studien bzw. was sagen sie nicht?

Die Leitsstudie sieht Voice AI als Vorteil

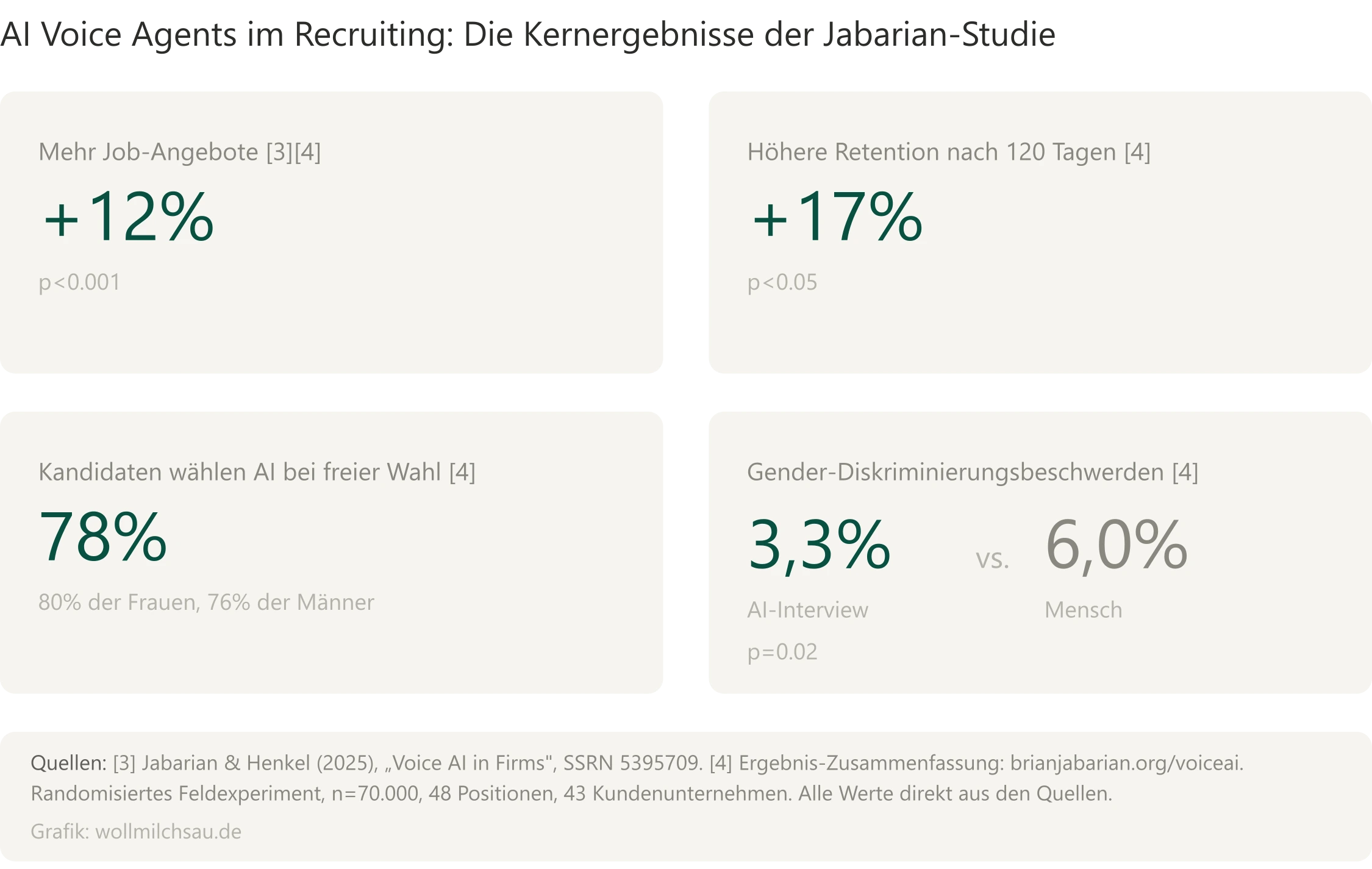

Die bislang größte Feldstudie zum Thema kommt von Brian Jabarian (University of Chicago Booth) und Luca Henkel (Erasmus University Rotterdam). In einem randomisierten Experiment wurden über 70.000 Bewerber-Interviews für 48 Positionen bei 43 Kundenunternehmen verglichen. AI Voice Agent traten gegen menschlichen Recruiter an. Die Kandidaten wurden zufällig einem von drei Pfaden zugewiesen: Interview mit einem menschlichen Recruiter (20%), Interview mit dem AI Voice Agent “Anna” (60%), oder freie Wahl zwischen beiden (20%). Die finale Einstellungsentscheidung lag in allen Fällen beim Menschen [3].

Die Ergebnisse: Kandidaten, die von der AI interviewt wurden, erhielten 12% mehr Job-Angebote. 18% mehr von ihnen traten die Stelle tatsächlich an. Die 30-Tage-Retention war signifikant höher, und der Effekt hielt auch nach 120 Tagen bei +17%. Die AI-Interviews waren dabei viermal schneller als menschliche Gespräche. 78% der Kandidaten wählten die AI, wenn sie die freie Wahl hatten, darunter 80% Frauen, und 76% Männer. Beschwerden wegen Geschlechterdiskriminierung sanken von 5,98% auf 3,30% [4].

Aber warum führen eigentlich die AI-Interviews zu mehr Einstellungen und besserer Retention? Die Analyse der Interview-Transkripte liefert einen Hinweis: Menschliche Recruiter arbeiten im Screening-Gespräch oft eine verkürzte Version des Interviewleitfadens ab. Sie springen oft zwischen Themen, lassen Fragen aus oder werden durch den Gesprächsverlauf abgelenkt. Im Durchschnitt kamen menschliche Recruiter auf 38% der vorgegebenen Themen. Die AI kam dagegen auf 45% und hielt sich dabei deutlich konsequenter an die vorgesehene Reihenfolge [4].

Jabarian nennt das “controlled variance”: Die AI reduziert die Schwankungsbreite in der Interview-Qualität. Jeder Kandidat bekommt ein gleich gründliches Gespräch. Der menschliche Recruiter, der am Ende die Einstellungsentscheidung trifft, bekommt dadurch eine konsistentere Informationsbasis.

Das sind natürlich starke Zahlen. Kritisch berücksichtigen müssen wir allerdings, dass die Studie auf standardisierten Rollen in Branchen wie Healthcare, IT, Versicherung und Einzelhandel aufbaut, also überwiegend Positionen mit klar definierten Anforderungsprofilen und hohem Bewerbungsvolumen. Der Autor selbst merkt an, dass AI-Interviewer für Rollen mit unvorhersehbaren Anforderungen, wie z. B. Krisenmanagement, kreatives Problemlösen, möglicherweise weniger geeignet sind [3, S. 30]. (*Die Studie wurde übrigens in Kooperation mit PSG Global Solutions durchgeführt, dem Anbieter des getesteten Voice Agents. Jabarian gibt an, dass PSG keinen Einfluss auf Analyse oder Veröffentlichung hatte.)

Das Gegengewicht: Was sagt die Forschung zur Fairness?

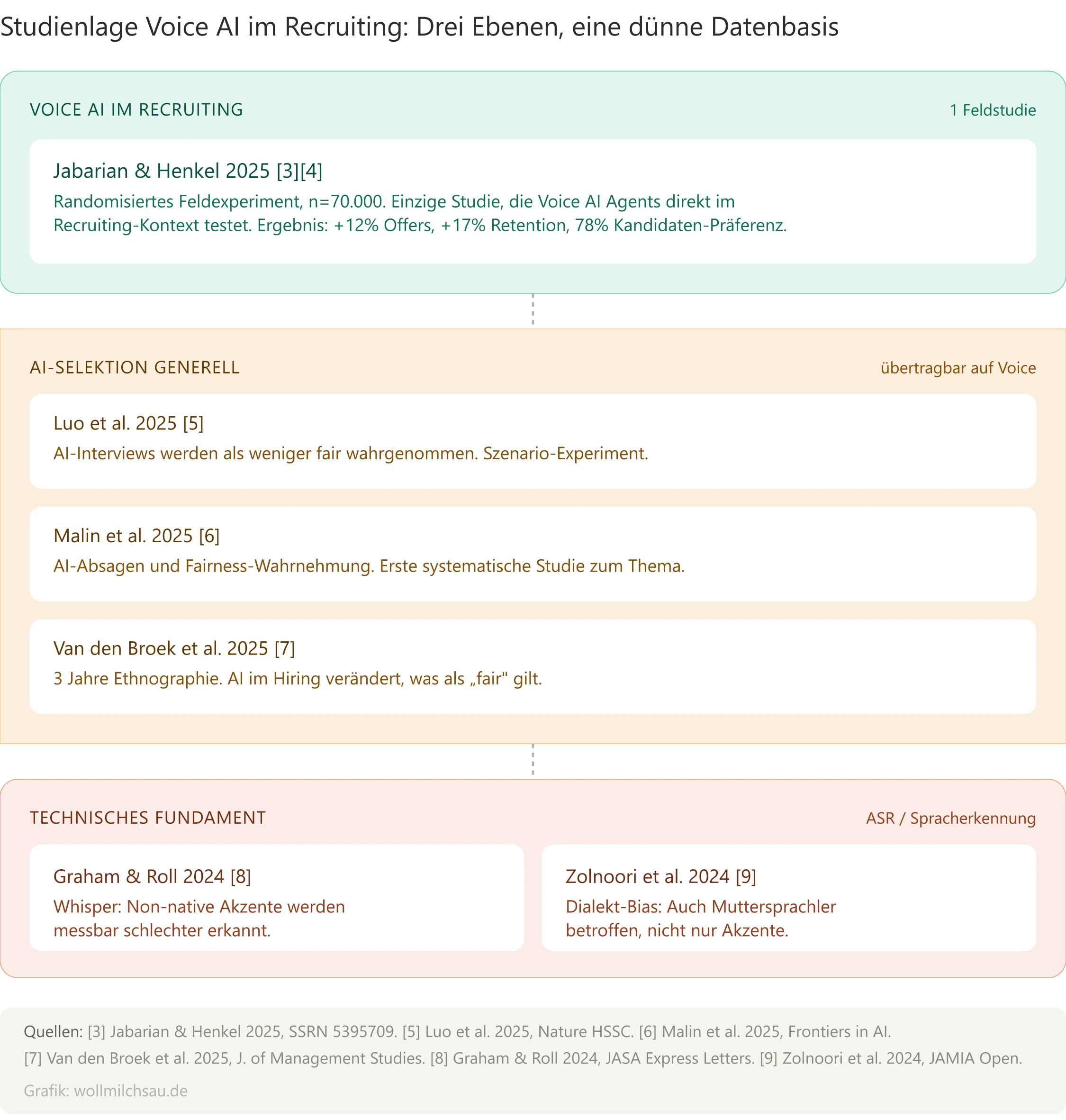

Studien, die sich explizit mit der Kandidaten-Erfahrung bei Voice-AI-Interviews beschäftigen, gibt es bislang kaum. Wer aber Voice AI in der Vorselektion einsetzt, sollte die Erkenntnisse aus der breiteren Forschung zu AI-gestützter Selektion im Blick behalten. Die Mechanismen, die dort beschrieben werden, sind auf Voice-Szenarien übertragbar. Wie nehmen Kandidaten eine algorithmische Entscheidung wahr? Was passiert mit dem Fairness-Empfinden, wenn kein Mensch mehr am anderen Ende sitzt? Und wer definiert eigentlich, was in einem AI-gestützten Prozess als fair gilt?

Eine Untersuchung von Luo et al. (2025), veröffentlicht in Humanities and Social Sciences Communications, zeigt: Kandidaten nehmen AI-geführte Interviews als weniger fair wahr. Nicht wegen der Ergebnisse, sondern weil sie das Gefühl haben, sich in einem standardisierten Format nicht angemessen präsentieren zu können. Die Möglichkeit, Eindruck zu machen und die eigene Persönlichkeit zu zeigen, fehlt [5].

Malin et al. (2025, Frontiers in Artificial Intelligence) haben untersucht, wie Bewerber auf Absagen reagieren, je nachdem ob ein Mensch oder eine AI die Entscheidung kommuniziert und wie die Absage begründet wird. Begründungen verbessern generell die Fairness-Wahrnehmung, auch wenn sie von einer AI kommen. Allerdings ist die Studie eine der ersten, die das überhaupt systematisch untersucht. Wie Bewerber auf unterschiedliche Typen von AI-Absagen reagieren und unter welchen Bedingungen, ist ein noch weitgehend offenes Feld [6].

Van den Broek et al. (2025, Journal of Management Studies) haben drei Jahre lang begleitet, was passiert, wenn ein internationaler Konzern AI im Hiring einführt. Der Algorithmus filterte nach festen Kriterien und sortierte dabei Kandidaten aus, die ein erfahrener Hiring Manager durchgewunken hätte, weil er den Kontext kannte. Die Pools wurden enger, nicht unbedingt besser. Die Hiring Manager verloren Einfluss auf eine Entscheidung, die am Ende sie verantworten mussten. Die übergeordnete Erkenntnis der Studie geht aber weiter: Wer AI im Recruiting einführt, entscheidet damit implizit, welche Definition von Fairness gilt. Diese Entscheidung wird in den meisten Unternehmen nicht bewusst getroffen [7].

Technische Herausforderung von Voice AI im Recruiting

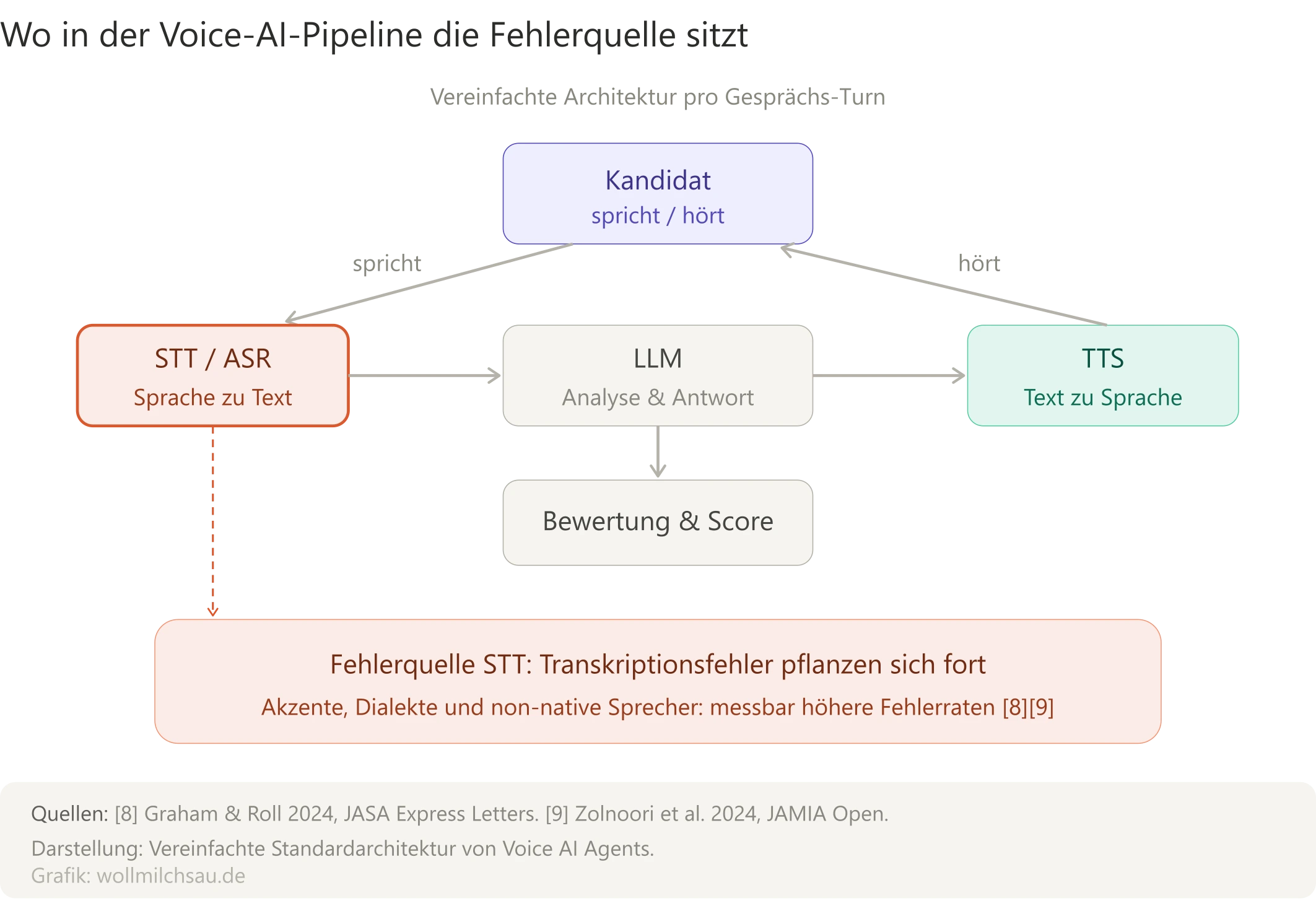

Die Fairness-Frage muss im Voice-AI-Kontext zusätzlich eine technische Komponente berücksichtigen: die Zuverlässigkeit der Spracherkennung, auf der jeder Voice Agent aufbaut.

Voice AI Agents basieren auf einer mehrstufigen Architektur. Am Anfang steht immer ein Spracherkennungssystem, das die Aussagen des Kandidaten in Text umwandelt. Erst auf Basis dieses Textes trifft die AI ihre Bewertungen. Graham und Roll (2024, JASA Express Letters) haben mit OpenAIs Whisper eines der am weitesten verbreiteten Spracherkennungssysteme über verschiedene Akzente hinweg getestet. Amerikanisches Englisch wird deutlich besser erkannt als britisches oder australisches, native Akzente insgesamt besser als non-native. Bei Sprechern mit tonalen Muttersprachen waren die Fehlerraten am höchsten. Einzelne britische Akzente wie Leeds erreichten Fehlerraten nahe 100% [8, S. 3–4].

Dass diese Disparitäten nicht nur Akzente betreffen, zeigt eine Studie von Zolnoori et al. (2024, JAMIA Open) aus dem Gesundheitsbereich: Vier ASR-Systeme transkribierten die Sprache von Black Patients durchgehend weniger genau als die von White Patients [9]. Der Grund ist nicht allein die Aussprache. Spracherkennungssysteme werden überwiegend auf Standardsprache trainiert. Wer einen eigenständigen Dialekt spricht, mit abweichendem Satzbau, eigener Grammatik oder regionalem Vokabular, wird schlechter erkannt, auch als Muttersprachler. Das Problem geht also tiefer als die Frage, ob ein System einen indischen Akzent versteht. Es betrifft auch Sprecher, die die Sprache perfekt beherrschen, sie aber anders verwenden als der Trainingsstandard.

Wenn schon die erste Stufe der Voice-AI-Pipeline fehlerhaft arbeitet, pflanzen sich die Folgen fehlerhafter oder ungleichmäßiger Transkription durch den gesamten Selektions-Prozess fort.

Die aktuelle Datenlage lässt mindestens zwei Schlüsse zu

A) Der Einsatz von Voice AI in der Vorselektion funktioniert tendenziell unter bestimmten Bedingungen. Standardisierte Rollen, hohes Volumen, klar definierte Anforderungen. Aber die Technik, die Candidate Experience und die regulatorische Absicherung müssen noch deutlich besser werden, bevor man das flächendeckend ausrollt.

Ab August 2026 greift der EU AI Act: AI-Systeme im Recruiting sind als High-Risk klassifiziert, mit verpflichtender Dokumentation, menschlicher Aufsicht und Bias-Monitoring [10]. Bewerber, die von einer AI-gestützten Entscheidung betroffen sind, haben nach Art. 86 zudem das Recht auf eine verständliche Erklärung, welche Rolle das AI-System im Entscheidungsprozess gespielt hat [10, Art. 86].

B) Und das ist die Frage, die mich mehr beschäftigt: Vielleicht ist das erste Screening-Gespräch gar nicht die Stelle im Recruiting-Prozess, an der Voice AI aktuell den größten Hebel hat. Vielleicht gibt es Einsatzszenarien, in denen die Stärken der Technologie (Verfügbarkeit, Konsistenz, Geduld) besser zur Geltung kommen als beim Aussortieren von Bewerbern. Dazu bald mehr.

Referenzen

[1] Gartner (2025), “Prepare for the Future of AI Agents in HR”, Dezember 2025. Zitiert nach: Eightfold AI. https://eightfold.ai/learn/gartner-prepare-for-the-future-of-ai-agents-in-hr/

[2] Staffing Industry Analysts (2025), “Voice AI is burgeoning tool for staffing firms, recent bug aside”, Mai 2025. https://www.staffingindustry.com/news/global-daily-news/voice-ai-is-burgeoning-tool-for-staffing-firms-recent-bug-aside

[3] Jabarian, B. & Henkel, L. (2025), “Voice AI in Firms: A Natural Field Experiment on Automated Job Interviews”, Working Paper, SSRN. Disclosure: S. 1; Experimentdesign: S. 8–12; Limitierungen zu Rollentypen: S. 30. https://papers.ssrn.com/sol3/papers.cfm?abstract_id=5395709

[4] Jabarian, B. (2025), Ergebnis-Zusammenfassung mit Retention-Daten, Topic Coverage und Experiment-Details. Abschnitte: Results, Design. https://brianjabarian.org/voiceai

[5] Luo, W., Zhang, Y. & Mu, M. (2025), “Why might AI-enabled interviews reduce candidates’ job application intention? The role of procedural justice and organizational attractiveness”, Humanities and Social Sciences Communications, Vol. 12, Art. 1278. https://www.nature.com/articles/s41599-025-05607-z

[6] Malin et al. (2025), “Rejected by an AI? Comparing job applicants’ fairness perceptions of artificial intelligence and humans in personnel selection”, Frontiers in Artificial Intelligence, Vol. 8. https://pmc.ncbi.nlm.nih.gov/articles/PMC12623313/

[7] Van den Broek, E., Sergeeva, A.V. & Huysman, M. (2025), “Is There Fairness in AI?”, Journal of Management Studies, DOI: 10.1111/joms.13276. Frei zugängliche Zusammenfassung der Autorinnen im Harvard Business Review, Dezember 2025: https://hbr.org/2025/12/new-research-on-ai-and-fairness-in-hiring https://onlinelibrary.wiley.com/doi/10.1111/joms.13276

[8] Graham, C. & Roll, N. (2024), “Evaluating OpenAI’s Whisper ASR: Performance analysis across diverse accents and speaker traits”, JASA Express Letters, Vol. 4(2). Akzent-Disparitäten: S. 3–4. https://pubs.aip.org/asa/jel/article/4/2/025206/3267247/Evaluating-OpenAI-s-Whisper-ASR-Performance

[9] Zolnoori, M. et al. (2024), “Decoding disparities: evaluating automatic speech recognition system performance in transcribing Black and White patient verbal communication with nurses in home healthcare”, JAMIA Open, Vol. 7(4). Ergebnisse: Results/Discussion. https://academic.oup.com/jamiaopen/article/7/4/ooae130/7920671

[10] EU AI Act, Regulation (EU) 2024/1689. High-Risk-Klassifizierung für AI im Recruiting: Annex III, Abschnitt “Employment”. Recht auf Erklärung: Art. 86. https://artificialintelligenceact.eu/article/86/. Deadline High-Risk-Anforderungen: Art. 113. https://artificialintelligenceact.eu/article/113/